| Ligne 29 : | Ligne 29 : | ||

-Imprimante 3D (ici la Ultimaker 2+)</translate> | -Imprimante 3D (ici la Ultimaker 2+)</translate> | ||

| + | }} | ||

| + | {{Tuto Step | ||

| + | |Step_Title=<translate></translate> | ||

| + | |Step_Content=<translate></translate> | ||

| + | }} | ||

| + | {{Tuto Step | ||

| + | |Step_Title=<translate></translate> | ||

| + | |Step_Content=<translate></translate> | ||

| + | }} | ||

| + | {{Tuto Step | ||

| + | |Step_Title=<translate></translate> | ||

| + | |Step_Content=<translate></translate> | ||

| + | }} | ||

| + | {{Tuto Step | ||

| + | |Step_Title=<translate></translate> | ||

| + | |Step_Content=<translate></translate> | ||

| + | }} | ||

| + | {{Tuto Step | ||

| + | |Step_Title=<translate></translate> | ||

| + | |Step_Content=<translate></translate> | ||

| + | }} | ||

| + | {{Tuto Step | ||

| + | |Step_Title=<translate>Système de détection de texte</translate> | ||

| + | |Step_Content=<translate>==== '''Le système utilise une caméra et un capteur à ultrasons pour détecter du texte .''' ==== | ||

| + | La caméra est utilisée pour capturer l’image du texte . Cette image est ensuite traitée par un logiciel de reconnaissance de caractères pour '''retranscrire le contenu en braille'''. | ||

| + | |||

| + | Le capteur à ultrason s mesure la distance entre la feuille et la caméra. Cela permet de s'assurer que la feuille est '''positionnée à la bonne distance''', garantissant ainsi une image nette et une reconnaissance optimale du texte.</translate> | ||

| + | |Step_Picture_00=Syst_me_de_traduction_et_d_apprentissage_du_Braille_capteur-de-distance-ultrason-hc-sr04.jpg | ||

| + | |Step_Picture_01=Syst_me_de_traduction_et_d_apprentissage_du_Braille_raspberry-pi-camera-module-3-12mp-objectif-standard-haute-resolution-sc0872.jpg | ||

| + | }} | ||

| + | {{Tuto Step | ||

| + | |Step_Title=<translate>Système d'interface homme-machine</translate> | ||

| + | |Step_Content=<translate>Le système est équipé de '''5 boutons physiques''' qui permettent de contrôler les différents modes d'apprentissage et la détection du texte. | ||

| + | |||

| + | ==== 1. Bouton '''Mode Leçon''' ==== | ||

| + | |||

| + | * Ce mode affiche les lettres de l’alphabet '''dans l’ordre''', avec un '''délai prédéfini entre chaque lettre'''. | ||

| + | * Objectif : permettre à l’utilisateur de '''mémoriser progressivement''' les lettres en braille. | ||

| + | |||

| + | ==== 2. Bouton '''Mode Exercice''' ==== | ||

| + | |||

| + | * Ce mode affiche des lettres '''de manière aléatoire'''. | ||

| + | * Objectif : tester et '''renforcer l’apprentissage''' de l’utilisateur sans se baser sur l’ordre alphabétique. | ||

| + | |||

| + | ==== 3. Bouton '''Suivant''' ==== | ||

| + | |||

| + | * Permet d'afficher '''la lettre suivante détectée''' (si l’on est en mode détection de texte). ==== 4. Bouton '''Précédent''' ==== | ||

| + | ** Permet de revenir '''à la lettre précédente''' dans la séquence. | ||

| + | |||

| + | ==== 5. Bouton '''Activation de la caméra''' ==== | ||

| + | |||

| + | * Ce bouton '''active la caméra''' pour lancer la '''détection du texte''' sur la feuille. | ||

| + | * Il fonctionne conjointement avec le '''capteur à ultrasons''' pour vérifier la bonne distance.</translate> | ||

| + | |Step_Picture_00=Syst_me_de_traduction_et_d_apprentissage_du_Braille_raspberry-pi-camera-module-3-12mp-objectif-standard-haute-resolution-sc0872.jpg | ||

| + | |Step_Picture_01=Syst_me_de_traduction_et_d_apprentissage_du_Braille_images.jpeg | ||

| + | }} | ||

| + | {{Tuto Step | ||

| + | |Step_Title=<translate>Communication I2C – Raspberry Pi & Arduino</translate> | ||

| + | |Step_Content=<translate>==== '''Dans le système ,la''' '''Raspberry Pi''' '''et l'Arduino''' '''communiquent ensemble via un''' '''bus I2C.''' ==== | ||

| + | Le système utilise une communication I2C entre une carte Raspberry Pi et une carte Arduino afin de séparer les tâches de traitement et de contrôle matériel. La Raspberry Pi joue le rôle de maître dans ce protocole : elle centralise la logique du programme, notamment la reconnaissance de texte, le choix du mode (leçon, exercice, détection), ainsi que l’interface utilisateur. Lorsqu’une commande doit être exécutée, par exemple afficher une lettre en braille, la Raspberry Pi envoie l’information correspondante à l’Arduino via le bus I2C. L’Arduino, en tant qu’esclave I2C, reçoit cette commande et active les servomoteurs nécessaires pour positionner les points braille. Ces servomoteurs, directement connectés à l’Arduino, vont permettre de retranscrire les lettres en brailles physiquement . Grâce à cette architecture, le système reste modulaire et performant : le traitement logiciel et la détection se font sur la Raspberry Pi, tandis que l’action mécanique est gérée de manière réactive par l’Arduino.</translate> | ||

| + | |Step_Picture_00=Syst_me_de_traduction_et_d_apprentissage_du_Braille_nm_arduino-front.jpg | ||

| + | |Step_Picture_01=Syst_me_de_traduction_et_d_apprentissage_du_Braille_91zSu44_34L._AC_UF1000_1000_QL80_.jpg | ||

| + | |Step_Picture_02=Syst_me_de_traduction_et_d_apprentissage_du_Braille_images_1_.jpeg | ||

| + | |Step_Picture_02_annotation={"version":"3.5.0","objects":[{"type":"image","version":"3.5.0","originX":"left","originY":"top","left":-41,"top":7,"width":251,"height":200,"fill":"rgb(0,0,0)","stroke":null,"strokeWidth":0,"strokeDashArray":null,"strokeLineCap":"butt","strokeDashOffset":0,"strokeLineJoin":"miter","strokeMiterLimit":4,"scaleX":2.7,"scaleY":2.7,"angle":0,"flipX":false,"flipY":false,"opacity":1,"shadow":null,"visible":true,"clipTo":null,"backgroundColor":"","fillRule":"nonzero","paintFirst":"fill","globalCompositeOperation":"source-over","transformMatrix":null,"skewX":0,"skewY":0,"crossOrigin":"","cropX":0,"cropY":0,"src":"https://wikifab.org/images/7/7e/Syst_me_de_traduction_et_d_apprentissage_du_Braille_images_1_.jpeg","filters":[]}],"height":478.15384615384613,"width":600} | ||

}} | }} | ||

{{Tuto Step | {{Tuto Step | ||

Version du 26 mai 2025 à 15:45

Introduction

Étape 1 -

Étape 2 -

Étape 3 -

Étape 4 -

Étape 5 -

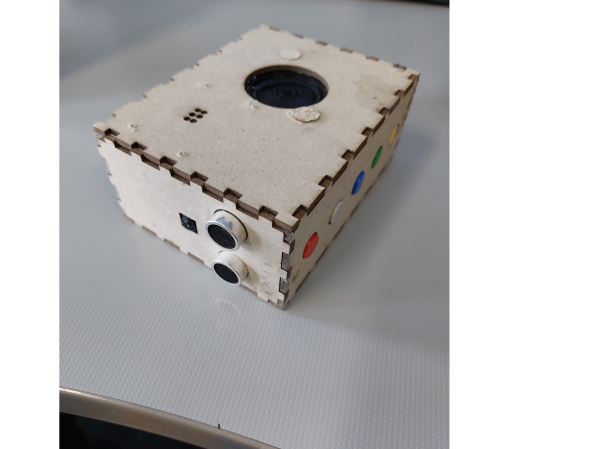

Étape 6 - Système de détection de texte

Le système utilise une caméra et un capteur à ultrasons pour détecter du texte .

La caméra est utilisée pour capturer l’image du texte . Cette image est ensuite traitée par un logiciel de reconnaissance de caractères pour retranscrire le contenu en braille.

Le capteur à ultrason s mesure la distance entre la feuille et la caméra. Cela permet de s'assurer que la feuille est positionnée à la bonne distance, garantissant ainsi une image nette et une reconnaissance optimale du texte.

Étape 7 - Système d'interface homme-machine

Le système est équipé de 5 boutons physiques qui permettent de contrôler les différents modes d'apprentissage et la détection du texte.

1. Bouton Mode Leçon

- Ce mode affiche les lettres de l’alphabet dans l’ordre, avec un délai prédéfini entre chaque lettre.

- Objectif : permettre à l’utilisateur de mémoriser progressivement les lettres en braille.

2. Bouton Mode Exercice

- Ce mode affiche des lettres de manière aléatoire.

- Objectif : tester et renforcer l’apprentissage de l’utilisateur sans se baser sur l’ordre alphabétique.

3. Bouton Suivant

- Permet d'afficher la lettre suivante détectée (si l’on est en mode détection de texte). ==== 4. Bouton Précédent ====

- Permet de revenir à la lettre précédente dans la séquence.

5. Bouton Activation de la caméra

- Ce bouton active la caméra pour lancer la détection du texte sur la feuille.

- Il fonctionne conjointement avec le capteur à ultrasons pour vérifier la bonne distance.

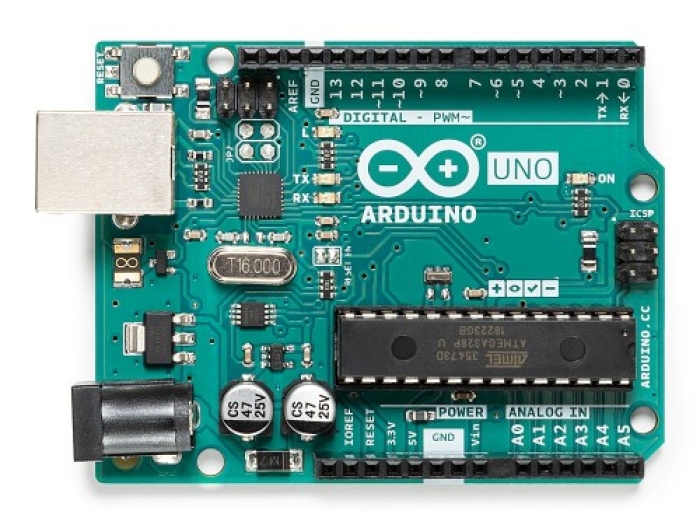

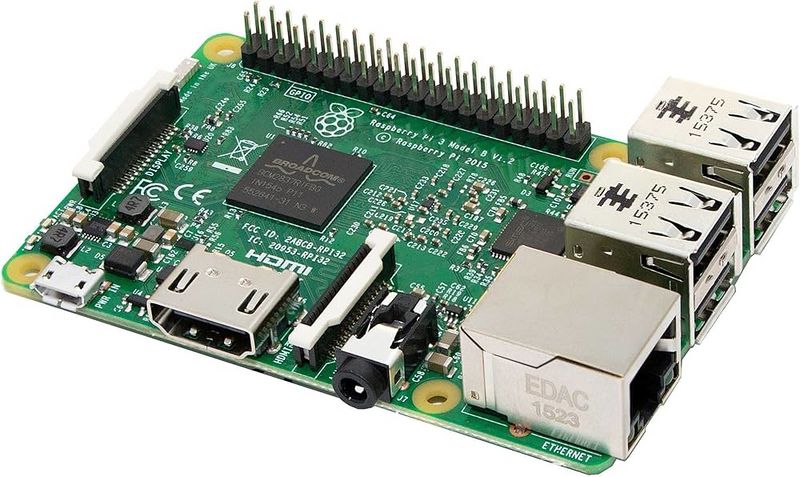

Étape 8 - Communication I2C – Raspberry Pi & Arduino

Dans le système ,la Raspberry Pi et l'Arduino communiquent ensemble via un bus I2C.

Le système utilise une communication I2C entre une carte Raspberry Pi et une carte Arduino afin de séparer les tâches de traitement et de contrôle matériel. La Raspberry Pi joue le rôle de maître dans ce protocole : elle centralise la logique du programme, notamment la reconnaissance de texte, le choix du mode (leçon, exercice, détection), ainsi que l’interface utilisateur. Lorsqu’une commande doit être exécutée, par exemple afficher une lettre en braille, la Raspberry Pi envoie l’information correspondante à l’Arduino via le bus I2C. L’Arduino, en tant qu’esclave I2C, reçoit cette commande et active les servomoteurs nécessaires pour positionner les points braille. Ces servomoteurs, directement connectés à l’Arduino, vont permettre de retranscrire les lettres en brailles physiquement . Grâce à cette architecture, le système reste modulaire et performant : le traitement logiciel et la détection se font sur la Raspberry Pi, tandis que l’action mécanique est gérée de manière réactive par l’Arduino.

Étape 9 -

Published

Français

Français English

English Deutsch

Deutsch Español

Español Italiano

Italiano Português

Português